هل تحوّل الذكاء الاصطناعي إلى خيمياء؟

التعلم الآلي يحتاج إلى المزيد من الصرامة بناءً على رأي الباحثين

وجّه علي رحيمي Ali Rahimi، وهو باحث في الذكاء الاصطناعي Artificial Intelligence (اختصارا: AI) لدى غوغل Google في سان فرانسيسكو بكاليفورنيا California، ضربةً لمجاله في ديسمبر الماضي ونال على ذلك تصفيقا استغرق أربعين ثانية. وفي حديثه في مؤتمر للذكاء الاصطناعي، اتهم رحيمي خوارزميات التعلم الآلي التي تتعلم خلالها الحواسيب عن طريق التجربة والخطأ، بأنها أصبحت شكلاً من أشكال الخيمياء Alchemy. وكما يقول، لا يعرف الباحثون لماذا تعمل بعض الخوارزميات ولا يعمل بعضها الآخر، كما أنّهم يفتقدون المعاييرَ الصارمة لاختيار بنية ذكاء اصطناعي واحدة على الأخرى. الآن، في ورقة قُدِّمت في 30 أبريل بالمؤتمر الدولي لممثليات التعلم International Conference on Learning Representations في فانكوفر Vancouver بكندا، قام رحيمي ومعاونوه بتوثيق أمثلة على ما يعتبرونه مشكلة في الخيمياء وتقديم وصفات لتعزيز صرامة الذكاء الاصطناعي.

ويقول رحيمي: “ إننا نعاني في هذا الحقل.” وأضاف: “يشعر الكثيرون منا بأننا نعمل على تقنية غريبة.”

تختلف هذه المشكلة عن مشكلة استنساخ الذكاء الاصطناعي (Science, 16 February, p. 725)، فلا يمكن للباحثين تكرار نتائج بعضهم البعض بسبب الممارسات التجريبية ونمط المادة المنشورة غير المتسقين. كما أنها تختلف عن مشكلة “الصندوق الأسود” Black Box أو “قابلية التأويل” Interpretability في التعلم الآلي: صعوبة شرح كيفية توصّل ذكاء اصطناعي معيّن إلى استنتاجاته (Science, 7 July 2017, p. 22). وكما يصفها رحيمي: “أحاول التمييز بين نظام التعلم الآلي وهو الصندوق الأسود وحقل كامل قد صار صندوقا أسود.”

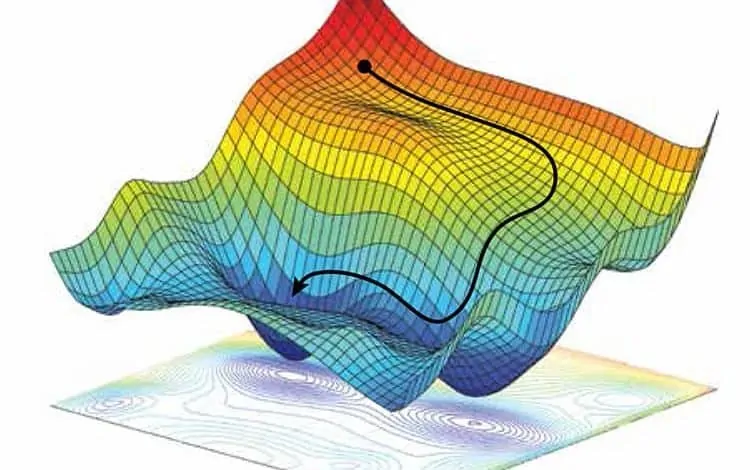

ويقول إنه من دون الفهم العميق للأدوات الأساسية اللازمة لبناء وتدريب خوارزميات جديدة، يلجأ الباحثون الذين ينشئون الذكاء الاصطناعي إلى الإشاعات، مثل الخيميائيين Alchemists في العصور الوسطى. ويضيف فرانسوا تشوليه François Chollet، المتخصص بعلم الحاسوب لدى غوغل في ماونتن فيو بكاليفورنيا: “ينجذب الناس حول ممارسات عبادة المنقول،” ويعتمدون على “العادات الشعبية والتعاويذ السحرية.” على سبيل المثال، كما يقول، يتبنون أسلوب الفحص لضبط “مُعدَّلات التعلم” Learning rates الخاصة بالذكاء الاصطناعي، وهي الطريقة التي تصحح بها الخوارزمية ذاتها بعد كل خطأ، دون فهم سبب أفضليتها عن الأخرى. وفي حالات يقوم الباحثون في مجال الذكاء الاصطناعي بتدريب خوارزمياتهم ببساطة كأنهم يتخبّطون في الظلام. وعلى سبيل المثال، فهم ينفِّذون ما يُطلق عليه “الانحدار المتدرج العشوائي” Stochastic Gradient Descent من أجل تحسين حدود الخوارزمية لأدنى معدل فشل ممكن. لكن، على الرغم من آلاف الأبحاث الأكاديمية حول هذا الموضوع، وطرق لا حصر لها لتطبيق هذه الطريقة، فلا تزال العملية تعتمد على التجربة والخطأ.

وتُبرز ورقة رحيمي الجهد الضائع والأداء دون المستوى الذي يمكن أن ينتج. فعلى سبيل المثال، بينت أنه عندما قام باحثون آخرون بتجريد معظم التعقيد من أحدث خوارزمية لترجمة اللغات، أنها قامت بالترجمة من الإنجليزية إلى الألمانية أو الفرنسية بشكل أفضل وأكثر كفاءة، موضّحة بذلك أنّ منشئي المحتوى لم يدركوا تمامًا ما كانت فائدة تلك الأجزاء الإضافية. وعلى العكس من ذلك، ففي بعض الأحيان، تكون الإضافات التي توضع على الخوارزمية هي الأجزاء الجيدة الوحيدة، كما يقول فيرينك هوسار Ferenc Huszár، الباحث في التعلم الآلي لدى تويتر Twitter في لندن. ويقول في بعض الحالات، يكون جوهر الخوارزمية معيب من الناحية الفنية، وهذا يدل على أنّ نتائجها الجيدة “تُعزى بالكامل إلى الحيل الأخرى تُطبق على نتائج الخوارزمية.”

ويقدم رحيمي العديد من الاقتراحات لتعلم أي الخوارزميات تعمل بشكل أفضل، ومتى. ففي البداية، كما يقول، يجب على الباحثين إجراء “دراسات اجتثاث” Ablation Studies مثل تلك التي تُجرى عند استخدام خوارزمية الترجمة: حذف أجزاء من خوارزمية واحدة في كل مرة لرؤية وظيفة كل مكون. إذ يدعو إلى “تحليل مُشرّح” Sliced Analysis ، بحيث يُحلّل أداء الخوارزمية بالتفصيل لمعرفة كيف يكون للتحسين في بعض المناطق تأثير في أماكن أخرى. ويقول إنّ على الباحثين أن يختبروا خوارزمياتهم مع العديد من الشروط والإعدادات المختلفة، ويجب عليهم تقديم تقارير عن جميعها.

ويقول بن رخت Ben Recht، المتخصص بعلم الحاسوب من جامعة كاليفورنيا University of California ببيركلي، والمؤلف المشارك للكلمة الافتتاحية عن الخيمياء لرحيمي، إنّ الذكاء الاصطناعي بحاجة إلى الاقتراض من الفيزياء، إذ يقوم الباحثون في كثير من الأحيان باختزال المشكلة إلى “مسألة لعبة”. “والفيزيائيون مذهلون في ابتكار تجارب بسيطة لاستبعداء التفسيرات المختلفة للظواهر،” كما يقول. وبعض الباحثين في مجال الذكاء الاصطناعي يتبنون بالفعل هذا المقاربة، ويختبرون خوارزميات التعرف على الصور على حروف صغيرة مكتوبة بخط اليد بالأبيض والأسود قبل معالجة الصور الملونة الكبيرة، من أجل فهم أفضل للميكانيكا الداخلية للخوارزميات.

ويقول سابا شيبزفاري Csaba Szepesvári، المتخصص بعلم الحاسوب في ديبمايند DeepMind بلندن، إنّ هذا الحقل يحتاج أيضًا إلى تقليل تركيزه على الاختبارات التنافسية. وفي الوقت الحاضر، فمن المرجح أن تُنشر ورقة ما إذا كانت الخوارزمية المبلّغ عنها تتفوق على بعض المعايير مقارنة بما لو كانت تلقي الضوء على ما يدور داخل البرنامج، كما يقول. وهذه هي الطريقة التي نجحت فيها خوارزمية الترجمة البارعة في التسلّل عبر مراجعة الأقران. “الغرض من العلم هو توليد المعرفة،” كما يقول. ويتابع: “أنت تريد إنتاج شيء يمكن للآخرين أخذه والبناء عليه.”

لا يتفق الجميع مع نقد رحيمي وريخت. ويخشى يان ليكون Yann LeCun، كبير علماء الذكاء الاصطناعي في فيسبوك Facebook بمدينة نيويورك، من أنّ تحويل الكثير من الجهد بعيداً عن التقنيات الحرجة ونحو الفهم الأساسي يمكن أن يبطئ الابتكار ويثني عن تبني الذكاء الاصطناعي في العالم الحقيقي. “إنها ليست خيمياء، إنها هندسة،” كما يقول. ويضيف: “والهندسة فوضوية.”

وريخت يرى مكانًا للأبحاث المنهجية والمُغامِرة على حد سواء. “نحن بحاجة إلى كلتيهما،” كما يقول. “نحن بحاجة إلى فهم نقاط الفشل حتى نتمكن من بناء نُظم موثوق بها، وعلينا دفع الحدود حتى نتمكن من الحصول على المزيد من النُّظم المثيرة للإعجاب.”