ما مدى ذكاء ChatGPT حقاً – وكيف نحكم على ذكاء أنظمة الذكاء الاصطناعي؟

بعد الادعاءات بأن الذكاء الاصطناعي أظهر أولى «شرارات الذكاء الاصطناعي العام»، ما مدى الاهتمام الذي ينبغي أن نسبغه على هذه التكنولوجيا بناء على الشهرة الإعلامية المحيطة به؟ خبيرة الذكاء الاصطناعي ميلاني ميتشل هي مرشدتنا في ذلك

بقلم دانيال كوزينز

استحوذ الذكاء الاصطناعي Artificial intelligence (اختصاراً: الذكاء الاصطناعي AI) على معظم الأخبار في السنوات القليلة الماضية. ومع ذلك، ازداد قرع الطبول في الأشهر الأخيرة إلى ذروته، ويرجع ذلك إلى حد كبير إلى أن بوت الدردشة Chatbot المدعوم بالذكاء الاصطناعي والمسمى ChatGPT قد أحدث ثورة في العالم بفضل قدرته على إنشاء النصوص بطلاقة، والإجابة بثقة على معظم أنواع الأسئلة. كل هذا يجعل الناس يتساءلون عما إذا كانت أنظمة الذكاء الاصطناعي AI قد وصلت إلى نقطة تحول Turning point.

النظام الحالي وراء ChatGPT هو نمذجة لغة كبير يسمى GPT-3.5، والذي يتكون من شبكة عصبية اصطناعية، وهي سلسلة من وحدات المعالجة المترابطة التي تُمكِّن البرامج من التعلُّم. لا يوجد شيء غير عادي في هذا حتى الآن. لكن ما فاجأ الكثيرين هو مدى قدرات الإصدار الأخير GPT-4. في مارس 2023، جادل باحثو مايكروسوفت Microsoft، الذين منحوا الوصول إلى النظام من قبل OpenAI -مطوّر ChatGPT – أنه من خلال إظهار البراعة في المهام التي تتجاوز تلك التي تم تدريبه عليها، إضافة إلى إنتاج لغة مقنعة، يعرض GPT-4 «شرارات» Sparks الذكاء الاصطناعي العام Artificial general intelligence. وقد كان هذا الهدف طويل الأمد لأبحاث الذكاء الاصطناعي AI، وغالباً ما يُنظر إليه على أنه القدرة على فعل أي شيء يمكن للبشر القيام به. غير أن العديد من الخبراء رفضوا ذلك، مجادلين في أنه بعيد جداً عن أن يكون ذكاء شبيها بالبشر.

إذن، ما مدى ذكاء أنظمة الذكاء الاصطناعي AI هذه، وماذا يعني صعودها بالنسبة إلينا؟ قلة هم في وضع أفضل للإجابة عن ذلك من ميلاني ميتشل Melanie Mitchell، الأستاذة في معهد سانتا في Santa Fe Institute في نيو مكسيكو ومؤلفة كتاب الذكاء الاصطناعي: دليل البشر المفكرين Artificial Intelligence: A guide for thinking humans. تحدثت ميتشل إلى مجلة نيو ساينتست New Scientist حول موجة الاهتمام التي يحظى بها الذكاء الاصطناعي AI، والتحديات في تقييم مدى ذكاء GPT-4، ولماذا يجبرنا الذكاء الاصطناعي AI باستمرار على إعادة التفكير في مفهوم الذكاء.

دانيال كوزينز: هناك اهتمام كبير بالذكاء الاصطناعي في الوقت الحالي. لماذا يتزايد الاهتمام الآن؟

ميلاني ميتشل: أولا، هذه الأنظمة أصبحت متاحة الآن للجمهور. يمكن لأي شخص اللعب بسهولة مع ChatGPT، لذلك يكتشف الناس هذه الأنظمة وما يمكنها فعله. على نطاق أوسع، نحن نشهد حقبة من التقدم المذهل في القدرات اللغوية Linguistic abilities. على مدى السنوات الخمس الماضية أو نحو ذلك، شهدنا ظهور هذه النمذجات اللغوية الكبيرة، التي دُرّبت على كميات هائلة من اللغة التي أنشأها الإنسان، وهي قادرة على إنشاء نص بطلاقة تبدو بشرية.

طلاقتها تعطي مظهر ذكاء يشبه الإنسان. لقد استحوذ هذا على خيال الناس. فهناك شعور بأن أنظمة الذكاء الاصطناعي AI التي رأيناها في الأفلام وقرأنا عنها في الخيال العلمي صارت متوفرة أخيراً. أعتقد أن الناس يشعرون بالدهشة والخوف جزئياً مما قد تفعله أنظمة الذكاء الاصطناعي AI هذه.

لقد ذكرت «ذكاء شبيه بالبشر». ما مدى ذكاء أنظمة الذكاء الاصطناعي التوليدية Generative AIs حاليا، مثل تلك التي تنشئ نصاً، وكيف يمكننا تقييم ذلك؟

هذا هو موضوع نقاش هائل. السبب الأول لذلك هو أن كل هذه المصطلحات التي نهتم بها، الذكاء Intelligence والفهم Understanding والوعي Consciousness، ليست محددة جيداً. السبب الثاني هو أن أنظمة الذكاء الاصطناعي AI هذه تعمل بشكل مختلف تماماً عن العقول البشرية. لقد رأينا مؤخراً أن GPT-4 نجح في اجتياز اختبار المحاماة، وهو اختبار موحد يجب على الأشخاص اجتيازه حتى يتمكنوا من ممارسة القانون في الولايات المتحدة. إذا أدى الإنسان هذا الاختبار جيداً، والذي يتضمن أسئلة الاختيار من متعدد وكتابة مقال قانوني، فسوف نفترض أن لديه الكثير من الذكاء العام. لكن من يقول إن مثل هذه الاختبارات هي طريقة مناسبة لتقييم ذكاء الذكاء الاصطناعي AI؟

ما الذي تقوم به هذه النمذجات اللغوية الكبيرة في الواقع، وما الذي يمكن أن يساوي ذلك من حيث الذكاء؟

لنبدأ بمفهوم نمذجة اللغة البسيط. أخذتُ سلسلة من الكلمات مثل «الضفدع الأخضر» ثم بحثتُ عن هذه الكلمات في كميات كبيرة من النصوص، ورصدت الكلمات التي تتبع هذه العبارة عادةً. لذلك قد يكون «قفز» أو «سبح» أو، أقل احتمالا، «قرنبيط». ما احتمال أن تأتي كل كلمة من هذه الكلمات بعد تلك العبارة؟ أخزن هذه الاحتمالات للعديد من سلاسل الكلمات الممكنة. ويمكنني الآن البدء بموجِّه نص Text prompt، ويمكنني البحث عن الكلمة التالية الأكثر احتمالاً. هذه هي الطريقة التي تعمل بها نمذجة اللغة البسيطة. في هذه الأيام نمنح الشبكات العصبية Neural networks الضخمة هذه المهمة المتمثلة بإيجاد احتمالات للكلمة، وندربها على أعداد هائلة من الأمثلة من النصوص المكتوبة. تسمى هذه الشبكات العصبية الضخمة «نمذجات اللغة الكبيرة» Large language models (اختصاراً: النمذجات LLM) وتتعلم ارتباطات إحصائية معقدة جداً بين العبارات. تكمن المشكلة في أنه نظراً لتعقيد الشبكة العصبية وعملياتها، من الصعب النظر تحت الغطاء والقول بالضبط ما تعلمته الشبكة من أجل التنبؤ بهذه الكلمات التالية.

لذلك، يمكنك القول إن أنظمة الذكاء الاصطناعي AI هذه تتنبأ فقط بالكلمة التالية، والتي لا تبدو مثيرة للإعجاب. لكن قد تجادل في أن هذه القدرة ترقى إلى شيء مثل الذكاء البشري.

نعم، إنه غامض. هناك ثلاث طرق يمكننا من خلالها تقييم نمذجات اللغوية. الأول هو أنه يمكننا التفاعل معها، كما أفعل مع الإنسان. أنت تتحدث إليه، وتطرح عليه أسئلة، وألغازاً، وترى كيف يتفاعل – ويشكل انطباعاتك. هذا مثل اختبار تورينغ Turing test، الذي يسأل بشكل أساسي: هل تبدو هذه الآلة بشرية؟ المشكلة هي أننا نحن البشر نميل إلى أن ننسب الذكاء بسهولة إلى الأشياء غير الذكية.

هناك طريقة أخرى وهي تجربة شيء مثل إعطاء ذكاء اصطناعي AI مجموعتين من الجمل، كل منها تتألف من جملتين، حيث تشير الجملة في المجموعة الأولى منطقياً إلى أن المجموعة الثانية صحيحة، وفي المجموعة الأخرى لا يوجد ما يشير إلى هذا الاتصال المنطقي. وقد نجحت أنظمة النمذجات LLM هذه في معرفة الجمل المرتبطة منطقياً. ولكن غالباً ما يتضح أنها تقوم بعمل جيد ليس لأنها فهمت الجمل بالطريقة التي يفهمها الإنسان، ولكن لأنها تستخدم ارتباطات إحصائية دقيقة.

أخيراً، يمكنك إلقاء نظرة على الشبكة العصبية نفسها ومحاولة فهم الآليات التي يحل بها النظام المشكلات. ويعكف الكثيرون على دراسة ذلك. لكنها مهمة صعبة جداً لأن النظام معقد جداً. لذلك، في النهاية، ليس لدينا حتى الآن اختبار دقيق وخالي من مشكلات لاختبار ذكاء نمذجات اللغة هذه.

هل تعتقدين أن محاولاتنا للسيطرة على قدرات الذكاء الاصطناعي ستجبرنا على صقل تعريفاتنا للذكاء والفهم؟

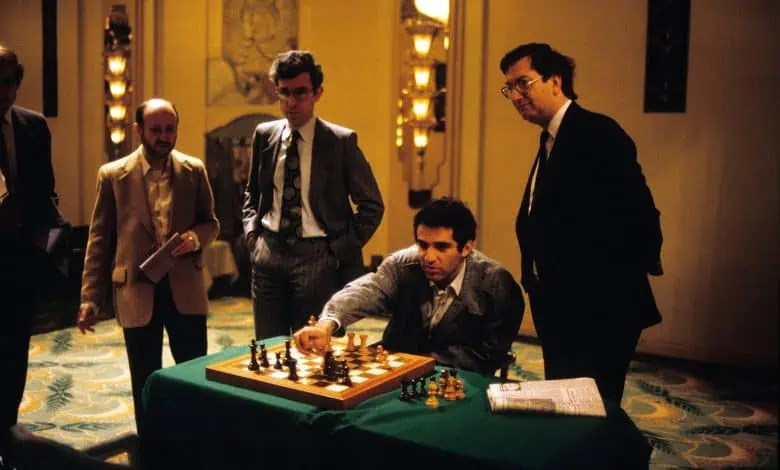

كانت هذه هي الحال طوال تاريخ الذكاء الاصطناعي AI بكامله. في سبعينات وثمانينات القرن العشرين، كان الكثير من الناس يقولون، حسناً، لعب الشطرنج على مستوى خبير كبير سيتطلب ذكاءً عاماً على مستوى الإنسان. ثم حصلنا على ديب بلو Deep Blue – الحاسوب العملاق الذي تغلب على الأستاذ الكبير غاري كاسباروف Garry Kasparov، ونقول إنه فاز بالضربة القاضية- الذي يبحث عن أفضل الحركات الممكنة. ونحن هنا مرة أخرى. يمكنك القول إننا نواصل تحريك عوارض المرمى. لكن يمكنني القول، في إطار أكثر إيجابية، أن الذكاء الاصطناعي يواصل تحدي مفهومنا لماهية الذكاء، أو ما نعنيه بالفهم.

الشيء هو أننا نعلم أن هناك عدة مظاهر مختلفة للذكاء. هناك ذكاء بشري يختلف تماماً، على سبيل المثال، عن ذكاء الأخطبوط، ومرة أخرى عن قوى الذكاء الاصطناعي AI التوليدية. يستخدم البعض منا عبارة «الذكاءات المتنوعة» Diverse intelligences، بصيغ الجمع، للتأكيد على أن الذكاء ليس شيئاً واحداً. كيف نميز بين هذه الذكاءات المختلفة؟ هل هناك سمات مشتركة؟ هل هي مختلفة كليا؟ هذه هي الأسئلة التي نريد النظر فيها.

هل أدهشك ما يمكن أن تفعله النمذجات اللغوية الكبيرة؟

لقد رأينا مؤخراً ما يسميه الناس «السلوكيات الناشئة» Emergent behaviours – وهي قدرات تتجاوز معالجة اللغة، ويمكن أن تبدو كأنها تفكير بشري. ويمكنك إعطاء مسائل الرياضيات للنمذجات LLM، أو تعليمات لكتابة كودات الحاسوب. يمكنك منحها قصصاً والطلب إليها مناقشة الشخصيات. ويمكنها بالفعل القيام بهذه الأشياء. ليس من الواضح على الإطلاق كيف يحدث هذا. إنها تعطي الانطباع بأنها قادرة على فهم العالم، بمعنى ما، بعد أن تم تدريبها للتو على كميات هائلة من النصوص التي أنشأها الإنسان. السؤال هو، هل تقوم بشيء مثل التفكير البشري؟ أم أنها تستخدم فقط ارتباطات إحصائية معقدة، والتي لا يبدو أنها الطريقة التي نفكر بها.

ما الأفكار الرائدة لما وراء هذه السلوكيات الناشئة؟

من السابق لأوانه قول ذلك، لأننا نحصل كل شهر على نسخة جديدة من هذه النمذجات يمكنها القيام بأشياء جديدة. باستخدام GPT-3، يمكننا على الأقل إلقاء نظرة على بيانات التدريب. ولكن مع GPT-4، لا يمكننا الوصول إلى هذا. تقول الشركة OpenAI إن هذا منتج تجاري، لذا فهي لا تريد منح ميزة للمنافسين. كما تشير الشركة أيضا إلى «الآثار المتعلقة بالسلامة». فلا شفافية في الأمر، لذلك من المستحيل إجراء البحث.

هل تعتقدين أننا نسير بالفعل على طريق الذكاء الاصطناعي نحو شيء يشبه الذكاء العام؟ أم أنك تعتقدين أن هذا سيتطلب نهجاً جديداً بالكامل؟

علينا أولا أن نسأل: ما الذكاء العام؟ مرة أخرى، ليس لدينا تعريف متفق عليه، لذا فإن قول ما يلزم لتحقيق ذلك أمر صعب لأنني لست متأكدة تماماً من الهدف. لقد سمعت الكثير من الناس في علم النفس يتساءلون عما إذا كان لدى البشر ذكاء عام. الذكاء البشري خاص جداً بمكانتنا التطورية وربما لا يكون بالعمومية التي نود أن نعتقد أنه عليها.

بعد قولي هذا، أعتقد أن مجرد توسيع نطاق هذه النمذجات لن يأخذنا على الأرجح إلى نوع الفهم الشبيه بالبشر الذي نريده. لا نريد مجرد فهم لغوي. نريد الفهم البصري، والقدرة على فهم وفعل الشيء الصحيح في موقف معين.

للوصول إلى هذه النقطة، أعتقد أننا سنحتاج إلى أنواع مختلفة من البنى. على سبيل المثال، لا تحتوي نمذجات اللغة مثل GPT-4 على ذاكرة طويلة الأمد لذلك لا تتذكر المحادثات السابقة ولا تهتم – بمعنى ما – بما قالته في الماضي. فقد أشير إلى أن الكثير من الذكاء البشري يتركز حول دوافعنا. أن الذكاء البشري هو وسيلة لتحقيق الأهداف التي وضعها التطور لنا. إذا لم يكن لدى النظام أي دوافع، أو أي أهداف الخاصة، فربما لا يتمكن من تحقيق نوع الذكاء الذي لدينا.

ما رأيك في فكرة أن الذكاء الاصطناعي يمكنه أو سيصبح مدركاً أو واعياً؟

كما أشار الفلاسفة لآلاف السنين، كيف لي أن أعرف أنك واعٍ؟ أعلم أنني واعٍ لأنني أستطيع الشعور به بطريقة ما. لكن ربما تكون مجرد زومبي. أعتقد أنني أفضل عدم الخوض في هذا النقاش لأنني لا أفهم المقصود به وأشعر بأن هذه المناقشات لا تؤدي إلى شيء.

كيف يمكن استخدام هذه النمذجات اللغوية بمجرد دمجها في حياتنا اليومية؟ وماذا ستكون طبيعة علاقتنا بها؟

سيكون هناك الكثير من التطبيقات اليومية، مثل جعلها تكتب رسائل البريد الإلكتروني أو التقارير. أعتقد أنها ستجعلنا أكثر إنتاجية. ومن الصعب التنبؤ بما إذا سيترتب عليها نتائج أكثر دراماتيكية. ربما تخرج المحامين من سوق العمل. ربما يستخدمها الأطباء للمساعدة على تشخيص الأمراض واتخاذ قرارات بشأن الرعاية الصحية. لا أعرف. لكن في الوقت الحالي، لديها الكثير من القيود التي تعني أنه يجب أن يكون هناك إنسان في الحلقة. نحن بحاجة إلى القدرة على التمييز بين الحقيقة والخطأ وهذه القدرة مفقودة من النمذجات LLM – هذه مشكلة أساسية.

في أبريل 2023، وقّع عدد كبير من خبراء الذكاء الاصطناعي البارزين على رسالة مفتوحة تدعو إلى وقف أبحاث الذكاء الاصطناعي. هل من الممكن أننا نتحرك بسرعة كبيرة؟

نعم هذا ممكن. غالباً ما تتحرك التكنولوجيا أسرع من السياسة والتنظيم. مع الذكاء الاصطناعي AI على وجه التحديد، هناك الكثير من المخاطر في نشر هذه الأنظمة في الرعاية الصحية والسياقات القانونية والصحافية – وجميع أنواع المجالات. لكنني لم أوقع على تلك الرسالة لأنني اعتقدت أنها خلطت بين مجموعة كاملة من الأشياء، بعضها يمثل مخاطر حقيقية وبعضها مجرد خيال علمي مخيف. وقد رسمت الورقة سيناريو يوم القيامة، وهو سيناريو لا أعتقد به.

وإن كنت أعتقد أنه يجب أن يكون لدينا تنظيم. يمكن أن تكون هذه الأنظمة خطيرة في الحياة اليومية: التحيز والمعلومات الخاطئة، وما إلى ذلك. لكنني لا أعرف ما إذا كان إيقاف البحث مؤقتاً هو الطريقة الصحيحة للتصرف حيال الأمر. بدلاً من ذلك، يجب أن نعرف البيانات التي تم تدريب الأنظمة عليها. لا يمكننا السماح لشركات مثل OpenAI بالقول بفاعلية: ثق بنا، نحن نعرف ما نقوم به.

ما الرسائل التي ترغبين في نشرها لمساعدة الناس على التفكير في مخاطر وفوائد الذكاء الاصطناعي في الوقت الحالي؟

أولاً، هذه الأنظمة ليست موثوقة فيها بعد. ولا هي واعية. إنها لا تقرر فعل أي شيء قد يضرنا. الاحتمال الحقيقي للضرر هو في استخدام البشر لها، ومن ثم نحن بحاجة إلى تنظيمها.

ثانياً، لمجرد أننا لا نفهم بالضبط كيفية عملها حتى الآن لا يعني أنها سحرية. إنها فقط معقدة جداً. سنكون قادرين على فهمها. نحتاج فقط إلى تطبيق العلم، وللقيام بذلك نحتاج إلى ألا تكون هذه الأنظمة بالكامل في أيدي الشركات الربحية.

توفر نمذجات اللغة هذه فرصة رائعة لتعميق فهمنا للإدراك. ويمكننا أن نتعلم الكثير منها عن أنفسنا، وحول كيفية عمل الذكاء البشري، وكيف يمكن للذكاء عموماً أن يعمل بطرق متنوعة. لكن في الوقت نفسه، يجب أن نكون مدركين لجميع الأخطار والمخاطر والقضايا التي ينطوي عليها تطبيقها في العالم الحقيقي.

© 2023, New Scientist, Distributed by Tribune Content Agency LLC.